Ковырялся тут в одной работе по наводке @rustamagamaliev и натолкнулся на фразу:

… использование интернета как сверхлёгкого способа получения информации приводит к тому, что человек стирает границы между своими собственными возможностями и возможностями электронных устройств, приписывая себе их сверхспособности [30]

Ниже я разберу ту самую работу [30], на которую была ссылка.

А пока хочу добавить еще одну мысль. Уже от себя и про искусственный интеллект:

ИИ опасен не сам по себе, опасность представляют те идиоты, которые, приписывая себе супер-способности ИИ, начнут раздавать другим людям советы, принимать критические решения и рисковать чужим благополучием...

А теперь вернемся к работе о том, как люди приписывают себе способности Google и наверняка будут приписывать себе суперспособности ИИ …

В работе описано два эксперимента, но нам интересен первый. Проводили его так:

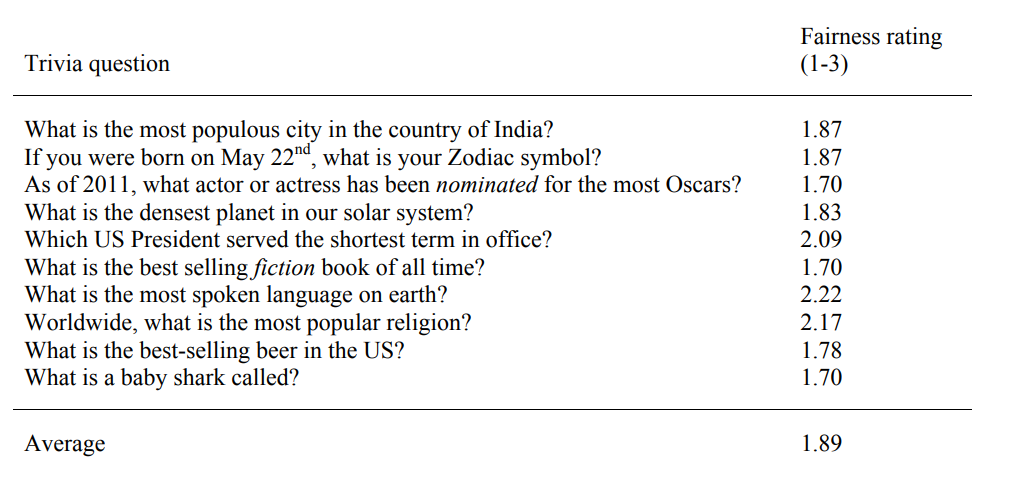

Испытуемым дали отвечать на квиз (список вопросов). Список вопросов взяли из этой диссертации:

Испытуемых разделили на три группы:

- Google - сказали, что ответы можно искать в гугле

- No Google - сказали, чтобы отвечали по памяти

- Control - ничего не говорили

Не важно, в какой группе было больше правильных ответов (в группа, вооруженных Google средний балл был 9,43 из 10, а в группе без гугла и контрольной 3,48 и 4,62 соответственно), любопытно другое…

Сразу после квиза испытуемым дали опросник, чтобы оценить их “когнитивную самооценку” - Cognitive Self-Esteem (шкала была разработана в рамках той же диссертационной работы) и включала вопросы вида:

- Я умнее, чем средний человек

- Моя память лучше, чем память среднего человека

- …

И нужно было указать свой уровень согласия с каждым из этих утверждений, после чего вычислялся балл.

И исследователи посмотрели средние значения и их отличия между группами. Уровень статистической значимости оказался в рамках приличий:

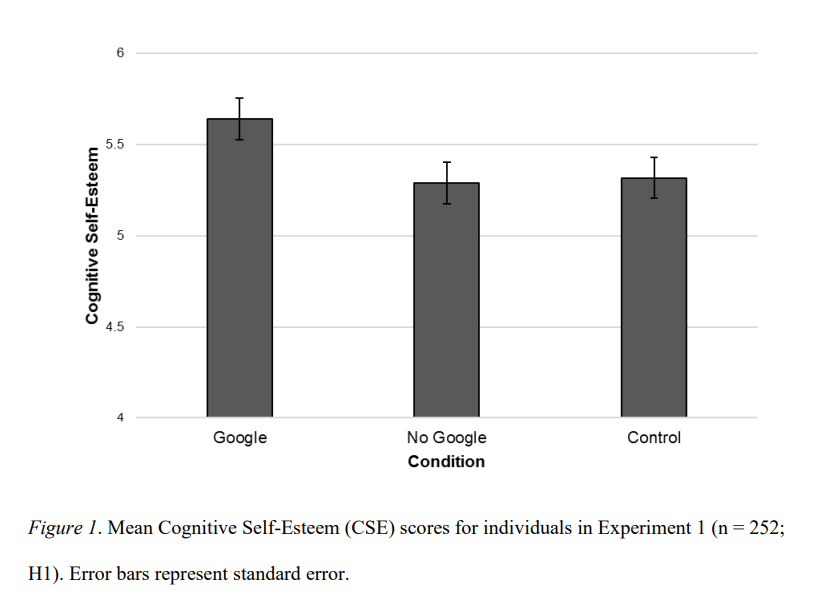

На картинке это выглядит так:

Тема принятия решений интересна

На личном уровне - что с этим делать в итоге тем кто принимает критические решения - стараться более фундаментальные источники данных выбирать?

Так, чисто чтобы пристрелочные оценки собственного опыта делать, можно попросить дополнить спектр вариантов степенью шкурности на кону (включая абсурдные крайности, для контраста)?

Чтобы понимать где я нахожусь и к чему стремиться. Уместна ли вообще такая прицелочная градация?

Я так понимаю, что последняя картинка отвечает на вопрос, влияет ли гугл на уверенность в своих знаниях. А насколько сильно влияет, говорить тежело? Вроде на полбалла разница в ответах.

Хотя какое там распределение внутри, мы тоже не знаем. Может есть люди, которые осознают, что за них думал гугл, а есть те, кто полностью присвоил результат.

По поводу уверенности в себе читал немного у Млодинова в "(Не) осознанное". Мол это сила бессознательного. И это нужная людям сила, которая помогает преодолевать неудачи. Да, люди неадекватно себя оценивают, но задача видимо у бессознательного другая, выживательная.

То что, что гугл помогает себя чувствовать увереннее, это не люди плохие. Возможно, так должно быть. Или, иначе быть не может.

Вроде были исследования, что люди склонны оптимистично смотреть на свою способность планировать. Может это из той же природы.

Но конечно мы можем это учитывать :)

Это еще статья написана в 2018 до ГоПоТы, а с этой балалайкой, в смысле с нейросетевыми ИИ, ситуация резко повернула в сторону ухудшения )) Мне приходится дочку прям аккуратно учить использовать, чтобы не подменить свой мозг, силиконовым )

Если человек смог воспользоваться устройствами и электронными мозгами и принял более эффективное решение, чем если без, — то вроде проблемы нет. Я вижу риски с переносом ответственности: если вдруг принятое решение окажется субоптимальным, то вроде это не я, а Гугл/gpt…

Мне кажется что вопрос упирается в ответственность; как говорят отечественные предприниматели: «кто сидеть будет?».

Интересно, сохраняется ли полученная из Гугла информация в головах испытуемых? Если повторный кейс получится пройти более успешно, то в костылях есть смысл.

Не стану на этот раз гуглить значение термина "Умный". Попробую на интуетивном уровне пораскинуть мозгами.

Умным мы называем человека который с помощью ума рашает задачку. При этом он использует арифметику, графические методы, исчислительные методы и справочные материалы.

Если справочный материал находится в голове, то скорость выше, а точность ниже.

Теперь про точность. У меня за плечами 2 выученные специальности. Автослесарем я изучел погрешности и зазоры в механизмах. А на факультете физики мы вообще делали вычисления округлённые до порядка. И даже если посчитать точно, то есть приближения второго порядка, потом третьего порядка и так делее..

Иными словами правильных ответов не бывает - бывают приемлемые.

В сыром остатке получаем: умный человек пользуется чем-то (почему бы и не гуглом). Зачастую применяет "чужие" концепции. Т. е. методы придуманые другими, которые непонятно почему назвал правильными.

И всегда ошибается в результатах. Дальше идёт субъективная оценка, на сколько можно пренебречь ошибкой такой величины.

И это с понтманием, что сам метод может быть не подходящим в данном случае.

Так кто умнее? Тот чья обезьянка меньше разрушает?

Мне кажется, что тут какие-то слишком далеко идущие выводы делаются из исследования. Уверен, что если провести аналогичное исследование, где вместо доступности Гугла разница будет в сложности вопросов в первой части, то те, у кого вопросы будут легче, точно так же будут выше оценивать свои способности.

Т.е. данное иссделование можно объяснить и так: люди склонны переоценивать свои способности, когда не сталкиваются со сложностями. А при ответе на справочные вопросы при помощи Гугла сложностям возникнуть мросто неоткуда

Помните фильм "Москва слезам не верит"?

"Скоро не будет книг, не будет театра, будет одно сплошное телевидение". Странно сейчас звучит эта фраза, правда?

Мне кажется, что с ИИ очень похожая история. Если человек привык перекладывать решения на маму/папу/начальника/гуру/гугл/ии - он так и будет делать.

Он будет считать себя при этом умнее, чем он есть на самом деле? Так и пусть считает. Других он, скорее всего, будет подбешивать, но чем больше таких "умных", тем больше другие будут задумываться, стоит ли становиться аналогами. Чем глупее пример - тем больше он будет отталкивать (я, во всяком случае, на это надеюсь).

Аузан в некоторых интервью рассказывал об эксперименте, который несколько лет проводится в МГУ. Сильные студенты и ИИ: кто в каких задачах лучше.

Кратко можно посмотреть вот тут:

Поддержу комментатора из Телеграма: у ИИ (которые LLM) пока суперспособности проявляются только в области перевода (и пр. смены стиля текста) и генерации больших объёмов текста, правда с малой насыщенностью смыслом, но зато часто содержащего разного рода ошибки. И даже с суммаризацией уже не всегда хорошо справляются.

Т.е. супер-способностей собственно и нет. Зато есть довольно распространённые нынче ожидания, что эти способности есть. И вот когда люди слишком полагаются на эти мнимые супер-способности (вроде способности самостоятельно запрограммировать веб-сервис), это уже действительно приводит людей к проблемам